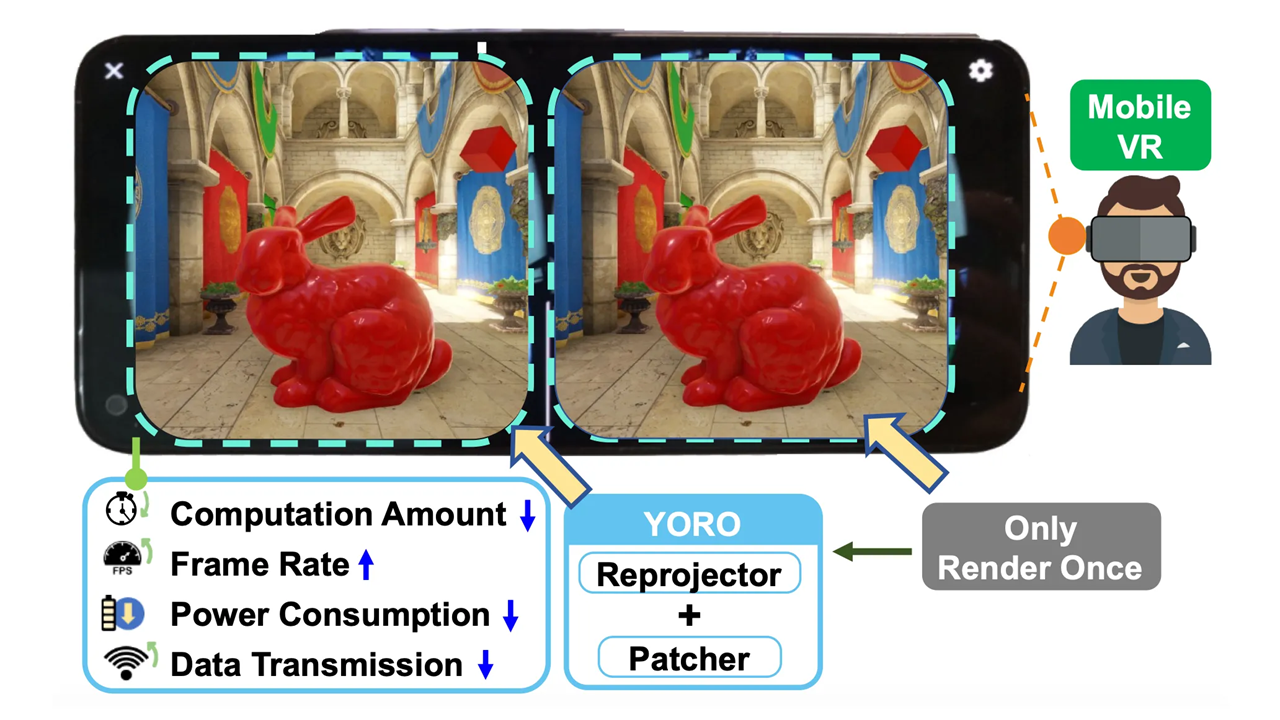

YORO VR boost la VR autonome en doublant le framerate et réduisant de 27 % la consommation sans sacrifier la qualité.

YORO VR : amélioration des performances VR

YORO pour « You Only Render Once » est une nouvelle technologie de rendu pour la VR mobile qui promet de doubler les performances tout en divisant par deux la consommation d’énergie. Une véritable révolution pour les utilisateurs de casques autonomes comme le Meta Quest 2 ou les smartphones compatibles.

La réalité virtuelle mobile est en pleine expansion, mais elle reste freinée par un problème majeur : le rendu binoculaire. Afficher une image par œil demande deux fois plus de calculs, ce qui surcharge les GPU mobiles, fait chauffer les appareils et réduit l’autonomie.

YORO : L’innovation qui va redéfinir la VR mobile

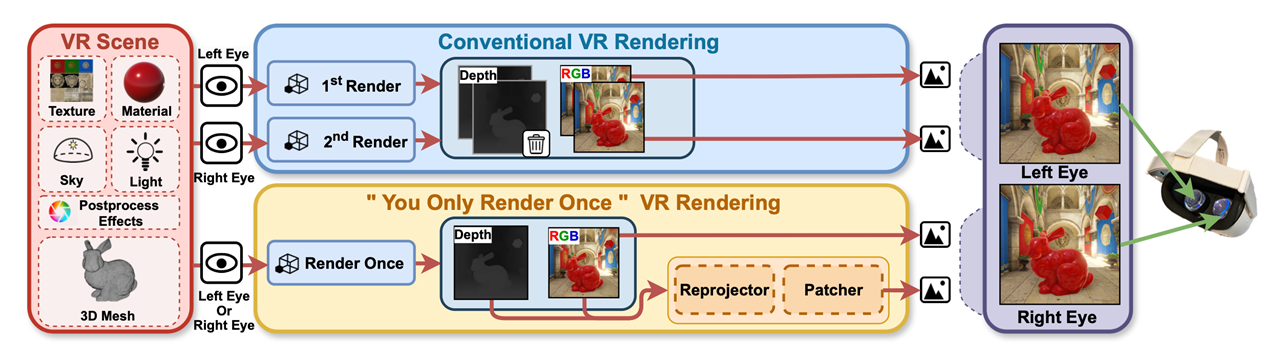

L’avenir de la réalité virtuelle est mobile. Que ce soit sur votre smartphone ou avec des casques autonomes comme le Meta Quest, les systèmes de VR mobiles sont de plus en plus populaires. Mais ils se heurtent à un obstacle majeur : le rendu des images. Pour créer l’effet de profondeur et l’immersion, la VR doit afficher une image légèrement différente pour chaque œil, un processus appelé rendu binoculaire. La méthode conventionnelle consiste à rendre chaque image séparément, ce qui consomme énormément de ressources et d’énergie. C’est ce qui cause la surchauffe de vos appareils et limite la qualité et la fluidité des scènes VR, provoquant parfois le mal des transports.

C’est là qu’intervient YORO, pour « You Only Render Once » (vous ne rendez qu’une seule fois). C’est un nouveau cadre d’optimisation conçu pour la VR mobile qui s’attaque directement à ce problème. L’idée est simple : au lieu de faire le rendu pour les deux yeux, YORO ne le fait que pour un seul, puis utilise une astuce intelligente pour créer l’image du second œil à partir de la première, économisant ainsi près de 50 % des calculs. Et le meilleur dans tout ça, c’est qu’il parvient à le faire sans sacrifier la qualité visuelle, comme le confirment les études utilisateurs.

Sommaire

Le génie derrière le rendu « une seule fois »

Alors, comment YORO parvient-il à générer une image binoculaire à partir d’un seul rendu ? Le processus se déroule en deux étapes principales, impliquant deux modules clés : le Reprojector et le Patcher.

- Le Reprojector : la magie de la reconstruction La première étape consiste à faire le rendu d’une seule image (pour l’œil dominant de l’utilisateur). En plus de la couleur (l’image RGB classique), le moteur de rendu produit une « carte de profondeur » (depth image) qui indique la distance de chaque pixel par rapport à la caméra. Le module Reprojector utilise ces informations de couleur et de profondeur pour reconstruire rapidement l’image manquante de l’autre œil. Il ne s’agit pas d’un simple copier-coller. En utilisant une « matrice de reprojection », le Reprojector décale les pixels existants pour simuler la différence de perspective entre les deux yeux. C’est un processus très léger qui s’effectue en parallèle sur le GPU, ce qui est idéal pour les appareils mobiles.

- Le Patcher : combler les trous Toutefois, cette reconstruction laisse inévitablement des « trous » là où un objet proche en cachait un plus éloigné dans l’image d’origine. C’est ce qu’on appelle la « disocclusion ». Le module Patcher est chargé de combler ces zones. Au lieu d’utiliser des méthodes lourdes et gourmandes en ressources (comme les réseaux neuronaux complexes ou le re-rendu de la scène), le Patcher de YORO utilise une approche basée sur des filtres. En s’appuyant sur les informations de profondeur, il peut remplir les pixels manquants en les « patchent » avec les couleurs de l’arrière-plan le plus proche. Ce processus est non seulement très efficace et rapide, mais il est également conçu pour être exécuté en parallèle, ce qui le rend parfaitement adapté aux performances des GPU mobiles

Meilleure expérience VR sans compromis

Les évaluations de YORO ont donné des résultats impressionnants, prouvant que cette approche est bien plus qu’une simple théorie. L’étude a été menée sur des appareils VR mobiles représentatifs, notamment le Meta Quest 2 et divers smartphones

- Réduction de la consommation d’énergie YORO permet une économie d’énergie moyenne de 27 % par rapport au rendu binoculaire conventionnel. Dans certaines scènes, cette réduction peut être encore plus importante. Pour vous donner une idée, la consommation d’énergie d’une application VR utilisant YORO est similaire à celle du simple fait de naviguer sur un site web, et à peine plus élevée que de regarder une vidéo. Cela signifie une autonomie de la batterie prolongée, passant des 2-3 heures habituelles à une durée de jeu bien plus confortable.

- Augmentation du taux de rafraîchissement La fluidité est cruciale en VR pour éviter le mal des transports. YORO excelle dans ce domaine, augmentant le taux de rafraîchissement (frame rate) de 115,2 % en moyenne. Le jeu est ainsi beaucoup plus fluide et stable, même dans des scènes complexes.

- Qualité d’image et immersion Les utilisateurs ne verront pas la différence. L’évaluation a montré que la qualité d’image générée par YORO est jugée « excellente » et « acceptable » selon des métriques reconnues (SSIM > 0,95 et PSNR > 20,0). Une étude utilisateur avec 14 participants a même conclu qu’il n’y avait pas de différence significative entre YORO et la méthode conventionnelle en termes de qualité d’image et d’expérience immersive. Quelques pixels peuvent être légèrement différents dans des cas extrêmes, mais ces situations sont rares dans la plupart des applications VR.

YORO VR vs SPI : le match est plié

YORO se positionne comme une solution supérieure par rapport aux autres méthodes d’optimisation existantes, comme le Single Pass Instancing (SPI). Contrairement à SPI qui ne réduit qu’une partie des calculs de rendu, YORO élimine un cycle de rendu complet, y compris les calculs de géométrie et d’ombrage.

Les tests montrent que YORO surpasse SPI en termes de taux de rafraîchissement, de consommation d’énergie et de stabilité, même lorsque SPI est utilisé dans ses conditions optimales.

les chiffres clés de l’éude :

Lors d’un test en conditions réelles sur un Quest 2 exécutant l’échantillon gratuit VR Beginner: The Escape Room d’Unity, l’implémentation de YORO a augmenté la fréquence d’images de 32 %, de 62 FPS à 82 FPS.

- Baisse de la urcharge de rendu du GPU de plus de 50 %

- +115 % de taux de rafraîchissement moyen

- −27 % de consommation énergétique

- Qualité d’image jugée excellente par les testeurs (SSIM > 0,95)

Une solution prête à déployer

YORO est une solution prête à l’emploi. Son implémentation ne nécessite pas de matériel spécialisé et est compatible avec les principales plateformes mobiles. Cette technologie pourrait également ouvrir de nouvelles portes pour le « VR streaming », en réduisant la quantité de données à transmettre, ce qui pourrait rendre le streaming VR de haute qualité plus accessible.

Le code source d’une implémentation Unity de YORO est disponible sur GitHub , sous licence publique générale GNU (GPL). Il est donc théoriquement déjà possible pour les développeurs de réalité virtuelle de l’intégrer à leurs jeux. Mais les développeurs de plateformes comme Meta, ByteDance et Apple adopteront-ils une technique similaire à YORO au niveau du SDK ou du système ?

Conclusion : YORO VR, l’avenir de la VR autonome (Quest, Pico, Pimax SE)

YORO représente un pas de géant pour la réalité virtuelle mobile. En résolvant l’un de ses plus grands défis, il permet de créer des expériences plus fluides, plus longues et plus agréables pour tous. Pour les développeurs, c’est une opportunité de créer des mondes virtuels plus riches et complexes sans se soucier des limitations matérielles actuelles. L’ère de casques VR autonomes plus puissants et plus efficaces est maintenant possible.

0 commentaires